Soziale Roboter bergen viel Potenzial, aber auch ein paar Gefahren

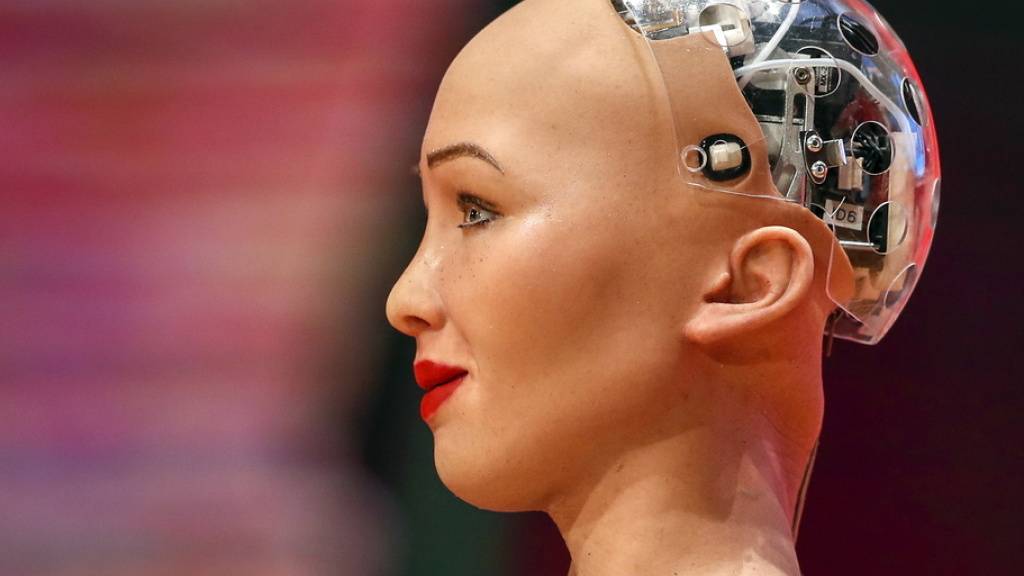

Schon jetzt gebe es Robotermodelle, die Emotionen und Sprachinhalte recht zuverlässig erkennen. Auch ihr darauf folgendes emotionales und empathisches Antwortverhalten wirke sinnvoll und überzeugend. Unter Laborbedingungen klappt das gemäss Studie gut, in der Realität seien die Leistungen deutlich geringer.

Deshalb, und weil soziale Roboter noch kaum verbreitet sind, ist das Zeitfenster laut Studie aktuell und in den nächsten Jahren geeignet, um gewisse Bedingungen und Grenzen beim Einsatz dieser «sensomotorischen Maschinen» zu definieren. Denn aufgrund des technologischen Potenzials werde früher oder später jeder vermehrt mit solchen Systemen interagieren.

Beim Roboter auf der Couch...

Die Studie basiert auf der vorhandenen Literatur, sowie Interviews und Diskussionsrunden mit Vertretern verschiedener Interessengruppen, beispielsweise aus dem medizinischen, dem erzieherischen, aber auch dem Herstellerbereich.

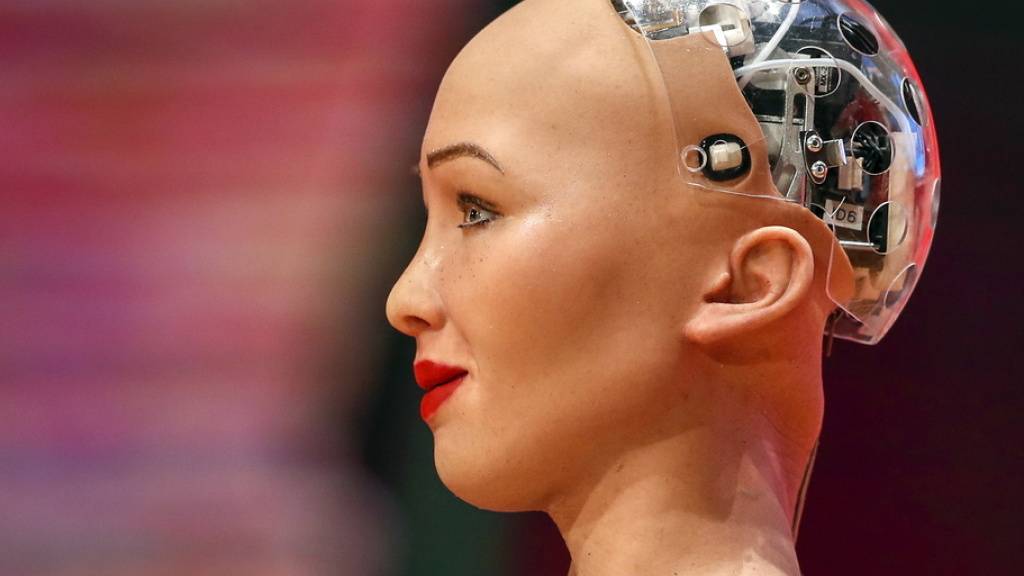

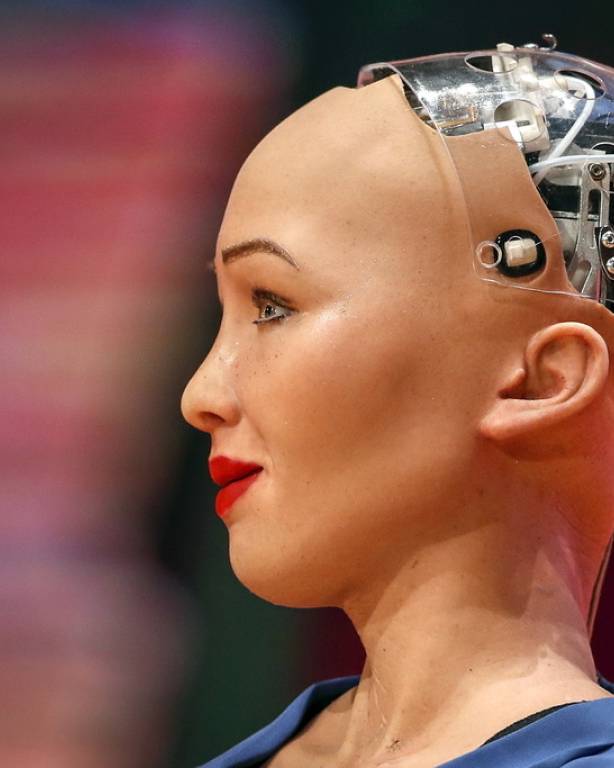

Befragte Psychotherapeutinnen und -therapeuten konnten sich beispielsweise einen Einsatz von sehr menschlich aussehenden und interagierenden sozialen Robotern als nützlich vorstellen. Eine Mehrheit der Befragten war aber der Meinung, das Aussehen sollte nicht allzu menschenähnlich sein, das führe sonst zu überzogenen Erwartungen.

...und mit ihm im Bett

Die meistgewünschte Funktion des sozialen Roboters war Assistenz und Unterstützung, vor allem in der Betreuung von Kindern, Kranken und Senioren. Sogar der Einsatz von sozialen Robotern als Prostituierten-Ersatz für sozial isolierte Personen wurde diskutiert. Die Studienverfasser empfehlen allerdings weitere Forschung auf diesem Gebiet.

Denn Ethik und Recht sind die Hauptgefahrenzonen. Die Studie empfiehlt Entscheidungsträgern insbesondere wenn es um den Umgang mit verwundbaren Menschen - Kinder, Kranke, Betagte - geht, Grenzen zu definieren. Zu viel Unterstützung könnte beispielsweise die sozialen Kompetenzen der Nutzer verkümmern lassen.

Der Mensch entscheidet über den Einsatz

Als zentral erachten die Forscherinnen und Forscher die Mitwirkung der Nutzer, mithin der ganzen Gesellschaft, bei der Entwicklung von Einsatzszenarien und Aufgabenprofilen sozialer Roboter.

Am interdisziplinären Projekt unter der Leitung der Hochschule für Angewandte Psychologie der Fachhochschule Nordwestschweiz (FHNW) beteiligten sich die Hochschule für Wirtschaft FHNW, die Pädagogische Hochschule FHNW, die ZHAW Zürcher Hochschule für Angewandte Wissenschaften (Departement Gesundheit) und die Universität St. Gallen.